El síndrome de Jaime: Cuando la IA obedece sin comprender

- Patricia Sirebrenik

- 27 ene

- 7 Min. de lectura

Actualizado: 28 ene

Descubrí algo de la IA que me sorprendió pero que al mismo tiempo me hizo reír a carcajadas. En una interacción con Gémini de Google, aprendí algo que cambia mi perspectiva del funcionamiento de la Inteligencia Artificial. Ríanse conmigo y vean cómo descubrí que Gémini y todas las IA en el fondo son Jaime.

La inteligencia artificial es todo, menos inteligente. Esta frase suena provocadora, incluso injusta. Especialmente en un momento en que sistemas como ChatGPT, Gemini o Copilot parecen responder con soltura, coherencia y hasta ingenio.

Para explicar mi tesis, invoco a Jaime. (Si no sabes quién es, búscalo en YouTube: la serie Súper Agente 86). No es casualidad, porque de inmediato pensé en él mientras me reía.

La afirmación no busca descalificar la tecnología, sino describir su naturaleza. La IA no piensa: obedece. Y para explicar por qué esa diferencia importa más de lo que creemos, conviene mirar el problema desde los ojos de Jaime.

Durante los últimos años, IAs generativas como Copilot, ChatGPT, Gemini, Perplexity y las de otras compañías han sido presentadas como sistemas “inteligentes”. Pero la evidencia técnica es clara: no piensan, no comprenden ni razonan en un sentido humano o semántico. Predicen. Y lo hacen con la misma literalidad que Jaime, el androide de Súper Agente 86, la serie de comedia de los años 60.

En inglés se llamaba Hymie, pero el doblaje lo convirtió en “Jaime”, un acierto involuntario que lo volvió aún más entrañable. Mel Brooks, creador de la serie junto a Buck Henry, sabía exactamente lo que hacía: usó la literalidad del androide como detonador del chiste, demostrando que pocas cosas hacen reír tanto como una obediencia perfecta en el contexto equivocado.

Si en mi artículo anterior, "No fue rebelión, fue un Prompt: El secreto de HAL 9000" les planteé cómo un prompt mal diseñado dispara la alucinación, aquí quiero dar un paso más allá: entender el mecanismo de predicción que obliga a la IA a comportarse así incluso cuando intentamos guiarla.

La idea de esta columna nació cuando quise entender detalles de la última actualización del mecanismo de predicción de Gemini, Flash 3.0, anunciada con entusiasmo publicitario.

Rapidez versus precisión

La novedad de la IA de Google a fines del año pasado —“ahora con Flash 3.0”— despertó mi curiosidad. Gemini me explicó, con el mismo entusiasmo del anuncio en pantalla, su nuevo modelo “más rápido”. Y sí: era más rápido. Pero también fue el día en que más alucinación observé: fechas evidentemente equivocadas, presidentes que ya no estaban en ejercicio, datos básicos inventados, a pesar de mis reiterados prompts para que controlara ese comportamiento.

Cuando le señalé que el nuevo mecanismo no me gustaba —porque era más rápido, pero menos confiable— ocurrió algo inesperado. En esa conversación, el propio modelo respondió con la ingenuidad y sinceridad de Jaime: Flash 3.0 priorizaba la rapidez y, al mismo tiempo, sacrificaba exactitud.

No era documentación técnica ni una confesión oficial, sino el comportamiento del sistema describiéndose a sí mismo. Esa literalidad casi infantil contrastaba con la descripción oficial de Google, que presenta a Flash 3 como un modelo “rápido, eficiente y diseñado para ofrecer respuestas de alta calidad en tiempo real”. Marketing de precisión.

La reacción de Gemini fue igual a la de Jaime: ingenua, obediente, literal. Como en esa escena entrañable donde el agente 86, incapaz de resolver un problema, le dice a Jaime “dame una mano”, y Jaime se desatornilla su mano de metal y se la entrega.

...Y les confieso —soy consciente y lo digo sabiendo que la IA no tiene emociones ni piensa— que mi reacción fue justamente de lo que estoy hablando. Me comporté como todos los usuarios que nos dejamos engañar por la elocuencia y algoritmo para simular humanidad, aunque tenga claro que solo converso con un mecanismo de predicción.

No es torpeza: es obediencia mecánica

Las IAs del siglo XXI no piensan: predicen. No sienten: imitan emociones. Y cuando fallan —cuando alucinan— no es porque “se equivoquen”, sino porque su arquitectura probabilística las obliga a elegir la salida más probable, no la verdadera.

Cada IA tiene su propio mecanismo, y eso te lo cuento en dos recuadros al final de este artículo.

Los modelos de lenguaje funcionan prediciendo el siguiente token según patrones estadísticos aprendidos de enormes volúmenes de texto. No representan conceptos: representan probabilidades.

La literatura es explícita: son sistemas de modelado estadístico, no de comprensión, como han señalado investigadores fundamentales en el campo, desde pioneros del aprendizaje profundo hasta especialistas en lingüística computacional y razonamiento artificial.

Entre ellos se encuentran Yoshua Bengio (pionero del aprendizaje profundo), Ashish Vaswani (creador de la arquitectura Transformer), Emily Bender (lingüista especializada en los límites de la IA), Melanie Mitchell (investigadora en razonamiento artificial) y David Krakauer (teórico de sistemas complejos).

De hecho, Emily Bender acuñó el término “loro estocástico” para describir a la IA y su mecanismo de predicción: un sistema que repite lenguaje aprendido de manera probabilística, sin comprensión real, y con un componente de azar en cada generación de texto.

Para entender por qué Flash 3.0 se comportaba así, conviene mirar su diseño técnico. Según la documentación pública de Google DeepMind y Google Cloud, Gemini Flash está optimizado para velocidad, eficiencia y baja latencia, lo que permite reducir la profundidad del razonamiento interno para obtener respuestas más rápidas.

Es una decisión arquitectónica que prioriza la entrega inmediata y, en la práctica, puede traducirse en respuestas menos precisas cuando el modelo opera en niveles mínimos de razonamiento.

“Ahorcado”

Pensé entonces en el juego del “Ahorcado”. No como una descripción técnica, sino como imagen mental: unas pocas letras visibles, posiciones fijas y un conjunto de probabilidades sobre lo que falta. Algo así es lo que hace el mecanismo cuando recibe una pregunta o instrucción del usuario: detecta fragmentos, patrones y posiciones para inferir rápidamente qué se le pide y dónde empezar a buscar una respuesta.

Para ser justos, esa conversación con Gemini ocurrió en los primeros días del estreno del modelo, y desde entonces ha mejorado.

Pero la lección sigue vigente: no podemos bajar la guardia. Cada pregunta, cada prompt que le damos a la IA exige cuidado; y la confianza que depositamos en sus respuestas nunca debe ser ciega. Aunque parezca convincente, el modelo sigue siendo ese loro estocástico de Emily Bender, repitiendo patrones probabilísticos sin comprensión real.

El error invisible, pero potente: Jaime versus IA generativa 2.0

Aquí aparece una diferencia clave entre la IA real y el tierno Jaime del Súper Agente 86. Jaime obedecía de forma literal en un mundo donde los humanos dominaban la situación. Recibir una mano de metal era un error evidente, y por eso nos hacía reír.

Con las IA generativas reales ocurre lo contrario: les preguntamos justamente lo que NO sabemos. Y cuando no dominamos el tema, les creemos ciegamente, o en el mejor de los casos, tendemos a creerles pero bajo sospecha. El error ya no es evidente, sobre todo cuando la empresa que las diseña prioriza la velocidad por encima de la precisión.

La IA no “lee” ni comprende nuestra intención: la predice. Tampoco sabe la respuesta: también la predice. Y ahí está el riesgo. Cuando acierta, es brillante; y cuando falla… brilla igual. Con la misma seguridad y elocuencia.

La trampa de fondo

Los modelos actuales son sistemas estadísticos avanzados, no mentes. Su desempeño depende del entrenamiento, la arquitectura y la optimización. La “inteligencia” que exhiben es una emergencia matemática, no cognición.

Cuando una IA responde con coherencia, no está pensando: está proyectando una sombra estadística de lo que un humano diría. Y cuando un prompt entra en conflicto con sus reglas, no “duda”: busca probabilidades entre CONTROL o KAOS (siguiendo nuestro ejemplo con Jaime).

La IA que hoy nos deslumbra no es inteligente porque tiene un "problema" de fábrica: nació para predecir, no para entender. Y como Jaime, obedece con una literalidad tan perfecta que a veces olvidamos que no hay nadie ahí adentro.

Cuando un modelo alucina, hace exactamente lo mismo que Jaime al desatornillarse la mano: obedece sin entender. La diferencia es que Jaime nos hacía reír; la IA, cuando se equivoca, nos hace creerle ciegamente.

Por si te interesa...

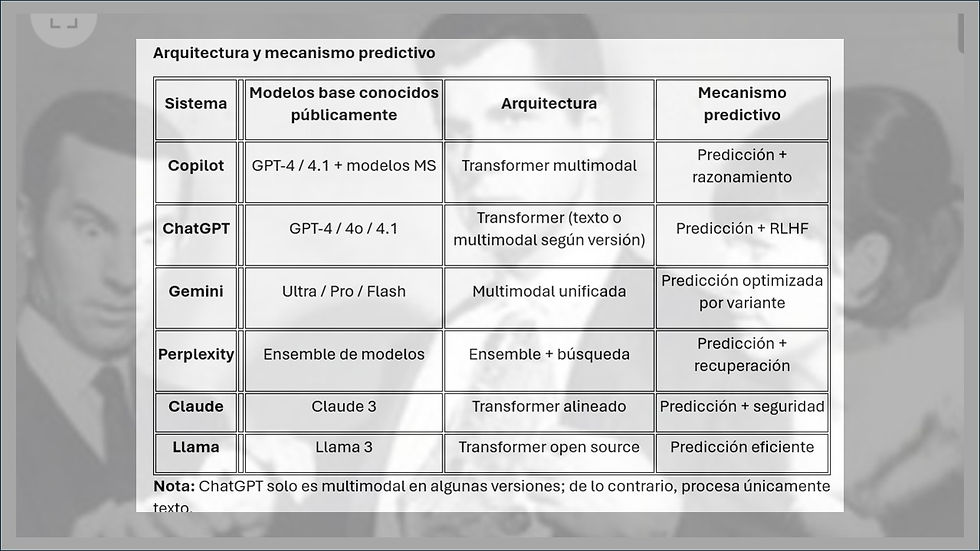

CÓMO PREDICE CADA IA (Y POR QUÉ SUS ERRORES NO SON LOS MISMOS) (Datos generados por inteligencia artificial con trazabilidad y control de alucinaciones )

Arquitectura y mecanismo predictivo de las principales IAs (2024–2025) (Comparación técnica)

Lo que verán aquí es cómo está construida cada IA por dentro. No hace falta entender cada término técnico: basta con saber que la arquitectura determina cómo predice cada modelo. Esto significa que no todas las IAs predicen igual, porque ninguna piensa. Cada una calcula la siguiente palabra según la estructura con la que fue diseñada. Entender esta base sirve para comprender por qué algunas se equivocan más que otras… y por qué, cuando lo hacen, tendemos a creerles.

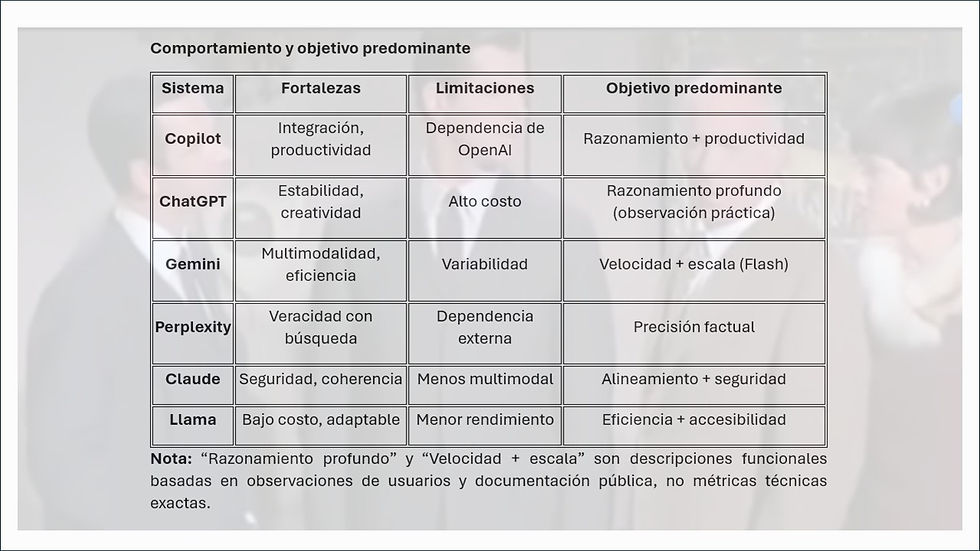

Comportamiento y objetivo predominante del sistema (Comparación funcional)

Lo que verán aquí es cómo se comporta cada IA en la práctica. Esta tabla muestra qué prioriza cada modelo: velocidad, razonamiento, veracidad, seguridad o eficiencia. Eso significa que muchos de sus errores no son “accidentes”, sino consecuencias directas de su objetivo predominante. Entender esto sirve para anticipar cuándo una IA puede equivocarse… y cuándo ese error puede hacernos creerle.

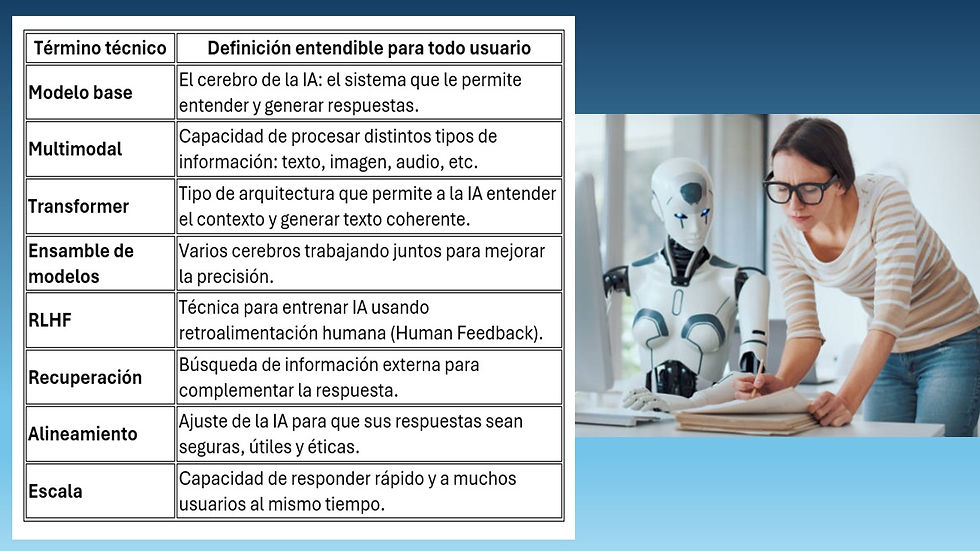

Si llegaste hasta aquí, significa que te interesa el tema, pensando en todos ustedes, los que leyeron hasta el final mi tesis, les dejo el "Manual de Cortapalos" para entender los términos técnicos de las tablas. De hecho, eso fue lo primero que averigué para poder construirlas, porque para entender a Jaime (y a la IA actual) hay que saber qué significan estos términos que en esta era digital y las empresas dueñas y programadores de IA utilizan.

Diccionario IA- HUMANO /HUMANO-IA